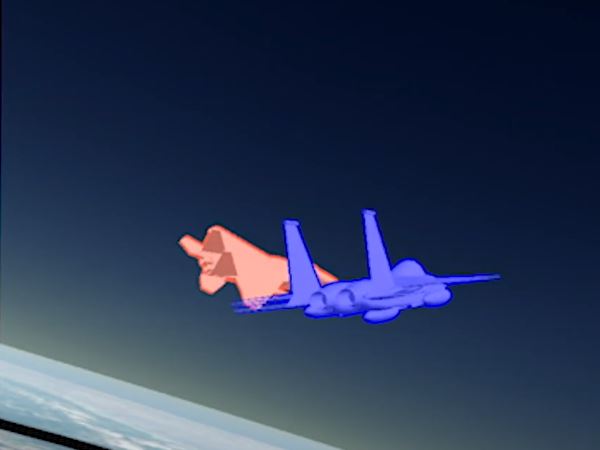

L’US Air Force veut voir un drone autonome et un avion de combat s’affronter lors d’un duel aérien

En juin 2016, l’US Air Force Research Laboratory s’était associé à l’entreprise Psibernetix pour réaliser une expérience qui a, depuis, fait date. Ainsi, cette dernière consista à se faire affronter dans une simulation de combat aérien le très expérimenté colonel Gene Lee et une intelligence artificielle, appelée Alpha. Le résultat fut sans appel : la machine prit le pas sur l’humain, alors que ses performances étaient limitées par un seul processeur de 3,2 GHz, cadencé à 154 Hz.

« J’ai été surpris par la manière dont elle était consciente et réactive. Elle semblait être consciente de mes intentions et réagir instantanément à mes changements en vol et à mes déploiements de missiles. Elle savait comment déjouer le tir que je faisais. Elle changeait instantanément entre les actions défensives et offensives en fonction des besoins », confiera le colonel Lee à Popular Science.

Depuis, la Darpa, l’agence du Pentagone dédiée à la recherche et à l’innovation, a lancé le projet « AlphaDogfight », reposant sur une compétion « virtuelle » conçue pour démonter que des algorithmes avancés d’intelligence artificielle peuvent exécuter des manoeuvres de combat aérien simulé [dog fight].

Il s’agit, explique la Darpa, de « dynamiser et d’élargir une base de développeurs pour le programme Air Combat Evolution [ACE], qui vise à automatiser les combats aériens et à renforcer la confiance humaine dans l’intelligence artificielle, qui est essentielle vers une meilleure association homme-machine ».

Ces expériences, entre autres, ont convaincu l’entrepreneur Elon Musk, le Pdg de SpaceX [espace] et de Tesla [voitures électriques]. « Les drones autonomes sont le futur. Ce n’est pas que je veuille que l’avenir soit ainsi mais c’est inéluctable… L’ère des avions de chasse est révolue », avait-il en effet déclaré en février dernier, lors du symposium « Air Warfare 2020. »

Cependant, Douglas Birkey, directeur exécutif du Mitchell Institute for Aerospace Studies, s’était opposé aux propos d’Elon Musk. « Pilote de chasse est l’une des professions les plus exigeantes au monde. Seul un petit pourcentage d’individus peut réussir à le devenir. Et encore, il faut des années d’expérience supplémentaires dans un cockpit pour être compétent. La quête ne s’arrête pas là non plus, les pilotes de chasse expérimentés doivent s’entraîner presque quotidiennement pour maintenir leurs compétences », avait-il commencé par rappeler.

« La raison en est simple : les pilotes de chasse qualifiés doivent être capables de maîtriser des manœuvres tridimensionnelles très agressives à des taux dépassant le double de la vitesse du son dans un espace de combat très dynamique, d’utiliser des équipements hautement sophistiqués et d’affronter des adversaires faisant tout ce qui est en leur pouvoir. pour les tuer. […] Comparez cela avec l’état actuel de l’intelligence artificielle dans un scénario beaucoup plus simple. Les voitures autonomes de Musk fonctionnent en deux dimensions, avec des lois de circulation prévisibles et un comportement humain compris. Fin 2019, trois voitures Tesla utilisant leur fonction de ‘pilote automatique’ ont eu des accidents », fit valoir Douglas Birkey.

Quoi qu’il en soit, le 4 juin, rapporte Air Force Monthly, le général Jack Shanahan, qui dirige le Joint Artificial Intelligence Center [JAIC] du Pentagone, a indiqué que l’Air Force Laboratory s’était fixé l’objectif d’organiser un duel aérien entre un drone autonome et un avion de chasse… en juillet 2021. Cependant, il n’a pas fourni de détail sur la conception du drone qui serait utilisé pour cette démonstration.

Les efforts de l’AFRL en matière d’intelligence artificielle sont « pilotés » par Steve Rogers. Or, ce dernier avait déclaré, à Inside Defense, en 2018, que l’objectif était d’abord de faire en sorte que l’intelligence artificielle soit une aide aux pilotes. Pas qu’elle les remplace.

« Nos pilotes, les très bons, ont quelques milliers d’heures d’expérience. Que se passera-il si je peux augmenter leurs capacités avec un système qui peut avoir accumulé littéralement des millions d’heures de formation? », avait demandé M. Rogers, pour qui un système reposant sur l’intelligene artificelle pourrait surtout prendre des décisions avant que l’humain ait conscience d’un problème ou d’une situation.

Cela étant, General Atomics a récemment présenté le concept d’un drone taillé pour le combat aérien, le « Defender ». Plus précisément, cet appareil serait destiné à « protéger les actifs aériens de haute valeur [AWACS, avions ravitailleurs, etc] de l’US Air Force dans un environnement contesté », avec des missiles air-air AIM-120 AMRAAM et une capacité de ravitaillement en vol.

Reste que le général Shanahan se veut prudent, soulignant qu’une technologie décrite comme futuriste n’était pas forcément un gage de réussite. « L’armée devrait étudier les leçons apprises par l’industrie automobile et tenir compte de ses avetissements », a-t-il dit. « Il n’y a pas de véhicule entièrement autonome sur les routes aujourd’hui », malgré les milliards de dollars investis dans ce concept, a-t-il relevé. « D’un autre côté, c’est une décennie d’expérience que nous devrions prendre en compte parce qu’elle a permis de beaucoup apprendre », a-t-il conclu.